Latent Diffusion for Language Generation 2023 - LD4LG Model Review

-

- 첨부파일 : LD4LG_보리_bory.io_everyservice.io_20240215_2.JPG (520.6K) - 다운로드

본문

논문 출처 >

Latent Diffusion for Language Generation

Justin Lovelace, Varsha Kishore, Chao Wan, Eliot Shekhtman, Kilian Q. Weinberger

LD4LG 모델 리뷰

1. 본 모델은 2개 버전의 논문이 있습니다

• 2022년 말에 발표된 논문 (A)

• 2023년 말에 발표된 논문 (B)

• GIT 의 코드는 A 버전을 코드화 한 것입니다

• B버전으로의 업데이트는 아직 적용되지 않았습니다.

2. 버전 B은 버전 A에 비해

• Compression Network 이 추가되면서 Latent space가 compact하게 정리되고 length가 fixed 되었습니다.

• 또한 Denoising 할 때 condition을 다양한 방법으로 적용할 수 있게 된 것으로 보입니다.

• 특히 Sequence-to-Sequence Diffusion 을 통해 Summarization, Translation 등을 가능하게 한 것이 인상적입니다.

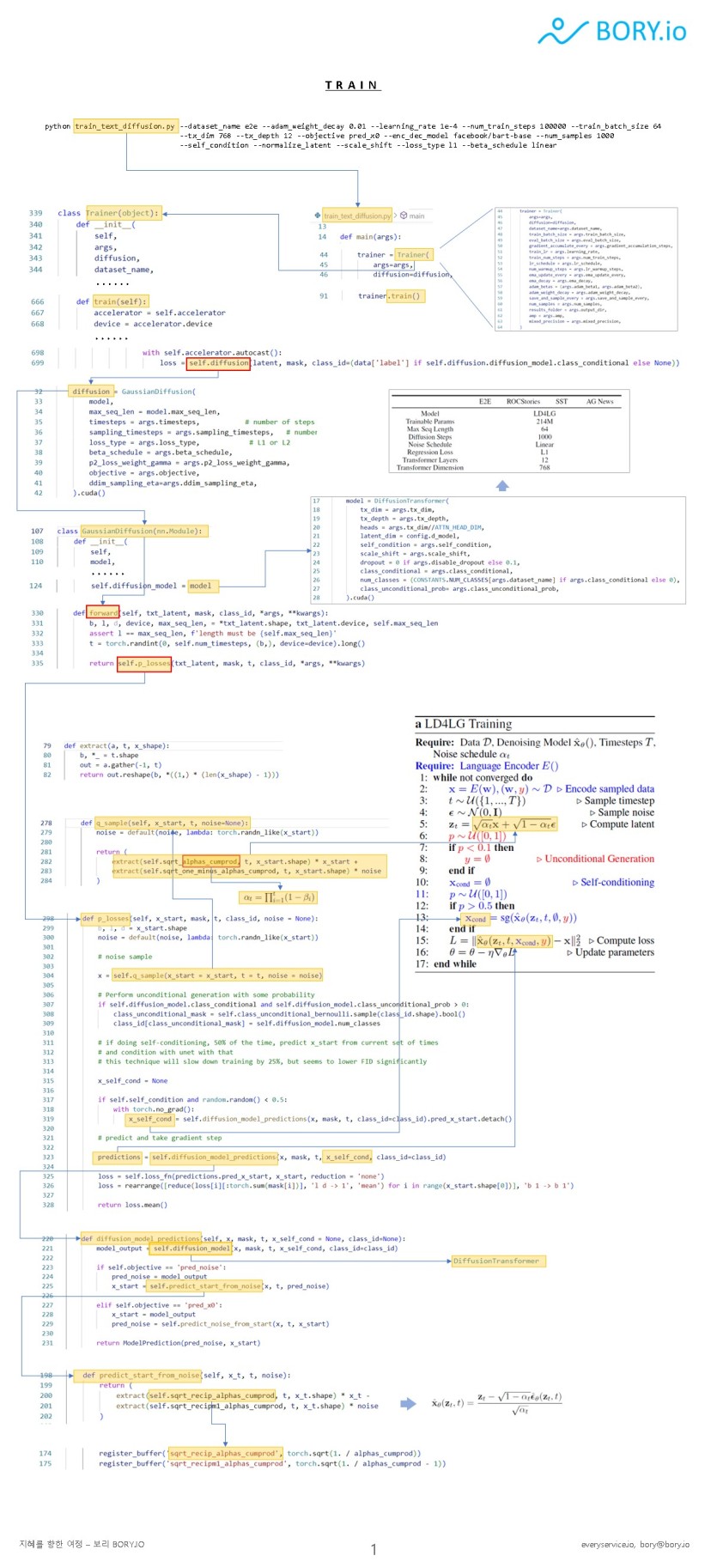

3. 본 모델 리뷰에서는

• GIT (A 버전의 논문)의 코드 중 주로 Diffusion Process 와 관련된 부분을 논문의 Figure 3의 Algorithm 과 연관하여 표시하였습니다.

• 준비한 리뷰 중 TRAIN 부분만 공개합니다.

==============================================

Source of thesis >

Latent Diffusion for Language Generation

Justin Lovelace, Varsha Kishore, Chao Wan, Eliot Shekhtman, Kilian Q. Weinberger

LD4LG Model Review

1. There are two versions of this model.

• Paper published at the end of 2022 (A)

• Paper published at the end of 2023 (B)

• The code in GIT is a codification of version A.

• The update to version B has not been applied yet.

2. Version B is better than version A

• With the addition of the Compression Network, the latent space has been compacted and the length has been fixed.

• It also appears that conditions can now be applied in a variety of ways when denoising.

• In particular, it is impressive that Summarization and Translation are possible through Sequence-to-Sequence Diffusion.

3. In this model review,

• Among the codes in GIT (version A of the paper), the parts mainly related to the diffusion process are shown in relation to the algorithm in Figure 3 of the paper.

• Only the TRAIN part of the prepared review will be disclosed.

댓글목록0

댓글 포인트 안내